Das gab Schlagzeilen: eine Studie zweier Wissenschaftler, darunter Prof. Rahmstorf vom PIK, hatte etwas herausgefunden, was in die Welt gehörte.

Überall konnte man es lesen: „Die Erde erwärmt sich seit 2015 wirklich schneller“

Was hatte die Arbeit gefunden und wie?

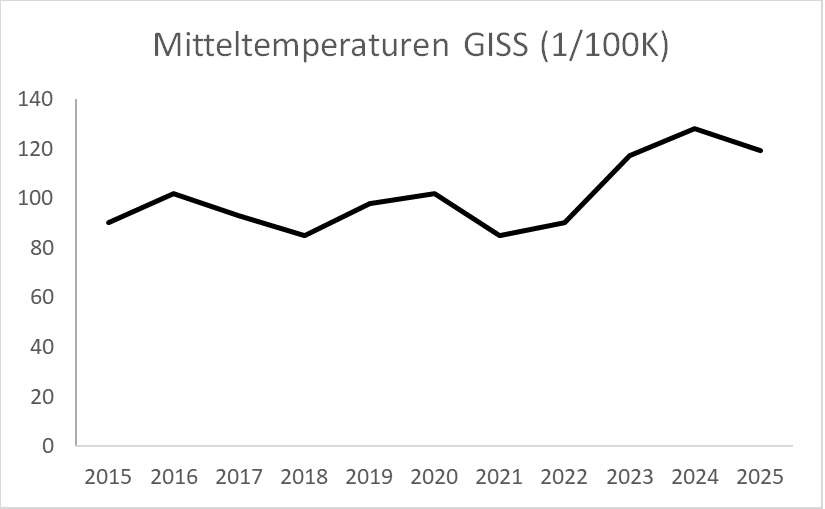

Zunächst ein Blick auf die Daten ab 2015 (Beschleunigung!) wie sie die NASA feststellt:

Gezeigt sind die jährlichen Temperaturanomalien gegenüber dem Zeitraum 1951-1980.

Auffällig ist, dass da bis 2022 nicht viel passierte, dann der Hub in den Jahren danach.

Wir hatten schon darüber berichtet, dass die Ursachen für diesen großen Sprung der globalen Temperaturen bisher nicht völlig geklärt sind. Es geht in der „Beschleunigungs-Arbeit“ auch gar nicht darum, Ursachen zu finden: es geht nur darum, zu zeigen, dass es sich beschleunigt „erhitzt“, wenn man den letzten Datenpunkt auf das Jahr 2024 legt. Es war das wärmste Jahr bisher, 2025 war wieder etwas weniger warm.

In den Daten wie sie sind können die Autoren denn auch nicht das so sehnlich Gesuchte finden:

es gibt da keine dramatischen Besonderheiten wie einen Wendepunkt.

Um doch eine Schlagzeile zu produzieren, müssen die Daten behandelt werden.

Die gleichen Autoren hatten im Jahre 2011 eine recht bekannte Studie (FR11) verfasst.

Darin beschrieben sie eine statistische Methode, wie man natürliche Einflüsse auf die globalen Temperaturen „herausrechnen“ könne.

Das sind, so die damalige Arbeit: Vulkane, die Sonne und das El Nino /La Nina Geschehen im Pazifik namens ENSO. Sie ordnete konstante Faktoren zu, um diese Einflüsse mathematisch zu behandeln. Im Fall von ENSO wird ein Maß (“MEI”) dafür benutzt und das mit dem Faktor ca. 0,08 und einem Zeitverzug von 4 Monaten von den oben gezeigten „GISS-Temperaturen“ subtrahiert, vgl. Tab.1 und Fig. 3 da.

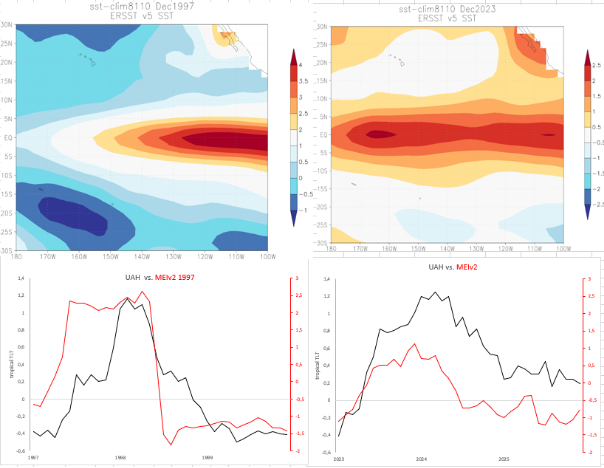

Eine Physik ist nicht beteiligt, die Einflüsse z. B. von Mustern von Wolken und alles andere wird mit dieser simplen Rechenoperation „abschließend“ behandelt. Wir wollen uns das einmal genauer ansehen für ENSO. Die „Rechenoperationen“ werden abgeleitet aus den alten gefundenen Koeffizienten für 1979-2010. Im Zeitraum trat ein „Super El Nino“ auf, im Jahre 1997/98. Er dürfte damit die „Optimierung“ der Eingangsgrößen damals maßgeblich bestimmt haben. Das vergleichen wir mit dem El Nino 2023/2024 sowohl im zeitlichen Ablauf als auch in der räumlichen Verteilung der zugehörigen Wärmemuster im Pazifik:

Links im Bild die Verhältnisse beim El Nino mit dem Maximum im Dezember 1997, oben in der Oberflächentemperaturverteilung (SST) des Pazifiks, unten im zeitlichen Verlauf der El Nino-Größe (rot) und der Temperatur der globalen tropischen Troposphäre (schwarz), rechts das gleiche für den El Nino im Jahre 2023. Der zeitliche Ablauf unterscheidet sich doch grundlegend: Im Jahr 1997 folgte die globale Troposphären- Temperatur mit monatelanger Verzögerung der Erwärmung der Meeresflächen im Ostpazifik nach und bestimmte damit die simple lineare Rechenoperation in FR11.

Im Jahre 2023 erfolgte der Temperatur-Anstieg in der Troposphäre im Gegensatz „wie von Geisterhand“ zeitgleich zu El Nino und wirkte viel länger nach als 1998. Die Antwort der Troposphäre auf ein im Index MEI nur halb so heftiges ENSO-Ereignis 2023 war ungleich viel stärker als 1997. Auch die Temperaturmuster sind völlig verschieden. In 1997 war die Wärme stark konzentriert auf den östlichen Äquator, im Jahre 2023 ist das viel flächiger und auch viel weiter nach Westen ausgreifend.

Ergebnis: Die Ereignisse sind völlig verschieden, auch die Auswirkungen. Eine „Gleichbehandlung“ ist überhaupt nicht gerechtfertigt! Das tut jedoch die „Beschleunigungs-Arbeit“. Sie schert sich nicht darum, irgendetwas physisches herauszufinden zum Sachverhalt, sie hat nur ein klares Ziel: Eine Schlagzeile.

Wie kommt sie nun mit der NICHT GERECHTFERTIGTEN (s. o.) Datenmassage dazu?

Im Prinzip vergleicht sie 10-Jahrestrends danach. „Bei Klima 10-Jahrestrends??“ fragt der unvoreingenommene Beobachter sofort: „Eigentlich sollte man da unter 30 Jahren überhaupt nicht anfangen!“.

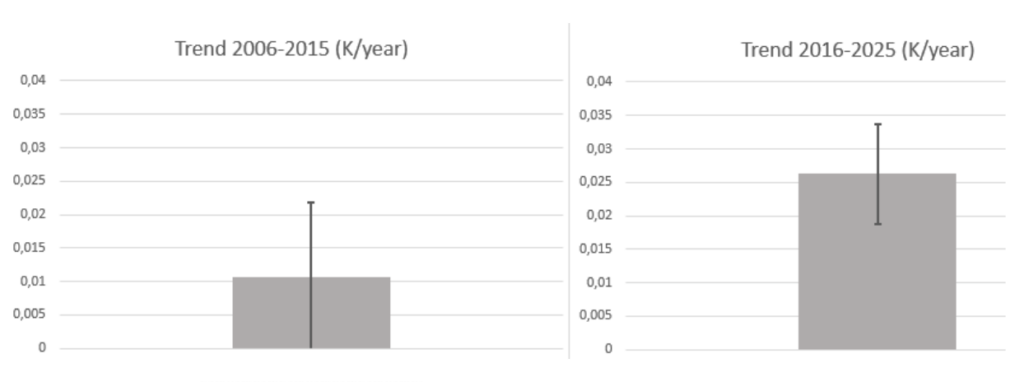

Das kann die Autoren nicht abhalten und sie finden denn auch eine „statistisch signifikante“ Beschleunigung der Erwärmung nach 2015. Der letzte benutzte Datenpunkt in der Studie ist 2024, der fragliche Trend also der von 2015-2024. Nun liegt ja aktuell auch der Wert für 2025 vor und man kann die Operation der Arbeit mit dem Trend 2016-2025 mit dem von 2006 bis 2015 vergleichen, auch 10-Jahrestrends vor und nach der „Beschleunigung der Erwärmung um 2015”. Bezieht man die großen Unsicherheiten von so kurzen Trends mit ein, gibt das ein anderes Bild:

Der lineare Trend (graue Säulen) ist zwar rechts klar höher. Die (95%) Fehlerbalken (schwarz) überlappen sich jedoch! Das bedeutet: Wenn man bis 2024 schaut, mag die reklamierte Signifikanz gegeben sein.

Nur ein Jahr später ist sie jedoch wieder dahin!

Mit solch kurzen Perioden wie hier 10 Jahre bei Klima irgendetwas von Belang herauszufinden, ist praktisch unmöglich. Sowohl beim „Vorbehandeln“ der Daten als auch bei der Trendberechnung danach ist viel zu viel statistische Unsicherheit im Spiel. Die vielfältigen und bisher nicht endgültig aufgeklärten Einflüsse, die zu dem Temperaturhub nach 2023 geführt haben, einfach mit den „Rechengrößen“ 1979-2010 behandeln zu wollen, ist ein weiteres „Stück aus dem Tollhaus“.

Die Frage, was die besprochene Studie zur wissenschaftlichen Erkenntnis beitrug, muss offenbleiben. Den Ehrgeiz konnte sie auch nicht im Ansatz erfüllen wollen. Es war wohl eher wieder ein „Stück für die Galerie“, für Medienschlagzeilen!

Was dabei am meisten Schaden nimmt, ist leider Wissenschaft.